Vos données sont centralisées dans un data warehouse performant, mais vos équipes commerciales et marketing ne les exploitent pas pleinement au quotidien ? Cette situation est fréquente. Les tableaux de bord se multiplient, les analyses deviennent plus précises, mais les actions concrètes restent limitées. Le Reverse ETL permet d’injecter les données analytiques directement dans les outils métier afin de combler cet écart.

Pourquoi le Reverse ETL est devenu un pilier de la modern data stack

Un data lake ou un data warehouse cloud centralise, nettoie et structure les données issues de multiples systèmes. Des plateformes comme Snowflake, Google BigQuery ou Amazon Redshift permettent de consolider d’importants volumes d’informations et d’obtenir une vision unifiée de l’activité.

Traditionnellement, le processus ETL alimente cet entrepôt pour produire des analyses via des outils de Business Intelligence. Le Reverse ETL adopte l’approche inverse : il synchronise les données déjà transformées vers les applications opérationnelles comme le CRM, les plateformes marketing ou les outils de support.

L’objectif n’est plus seulement d’analyser les données, mais de les activer directement dans les outils utilisés par les équipes terrain.

Comment fonctionne concrètement un flux Reverse ETL

Un flux Reverse ETL repose sur trois étapes principales.

La première consiste à sélectionner les données pertinentes dans l’entrepôt, par exemple des scores, des segments ou des indicateurs calculés.

La deuxième étape correspond au mapping des champs entre le data warehouse et l’application cible. Il s’agit d’assurer la correspondance entre les identifiants internes et ceux du CRM ou de la plateforme marketing.

La troisième étape met en place une synchronisation automatisée, programmée en batch ou en quasi temps réel selon les besoins métier.

Des solutions spécialisées comme Hightouch ou Census facilitent la gestion de ces flux sans développement complexe.

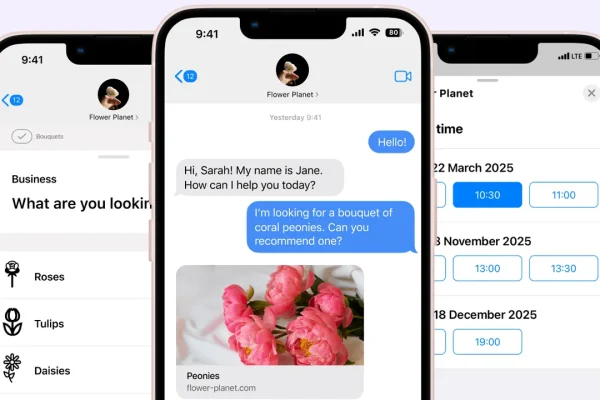

Prenons un exemple concret. Un score de churn est calculé chaque nuit dans l’entrepôt, puis automatiquement injecté dans Salesforce ou HubSpot. Les équipes commerciales identifient immédiatement les comptes à risque et priorisent leurs actions. L’analyse devient ainsi directement exploitable.

Reverse ETL et ETL traditionnel : quelles différences stratégiques

Le ETL classique alimente la couche analytique.

Le Reverse ETL alimente la couche opérationnelle.

Dans une architecture ELT moderne, les données brutes sont stockées dans le data warehouse puis transformées à l’aide d’outils comme dbt Labs. Une fois structurées, elles peuvent être exploitées par la BI ou synchronisées vers les outils métier.

Le Reverse ETL intervient après la phase de transformation. Il s’appuie sur des tables fiables, documentées et gouvernées. Sans qualité de données, la synchronisation peut amplifier des erreurs au lieu de générer de la valeur.

Les cas d’usage du Reverse ETL à fort impact business

Plusieurs scénarios offrent des résultats rapides et mesurables.

En priorisation commerciale, un score de propension à l’achat déclenche automatiquement l’ajout d’un tag dans le CRM dès qu’un prospect dépasse un seuil défini.

En segmentation marketing, les historiques d’achat permettent de recalculer des segments qui sont ensuite synchronisés vers la plateforme d’emailing.

En prévention du churn, les clients identifiés comme à risque sont transmis aux équipes Customer Success pour une prise de contact proactive.

En optimisation des stocks, les prévisions issues des modèles analytiques sont injectées dans les systèmes d’approvisionnement afin d’ajuster les niveaux en fonction de la demande.

Dans ces situations, la donnée ne reste pas cantonnée à un tableau de bord. Elle déclenche une action précise.

Les prérequis techniques pour réussir un projet Reverse ETL

Un projet de Reverse ETL exige une base technique solide.

L’identité client unifiée est essentielle. Les identifiants doivent être cohérents entre le data warehouse et les outils cibles. Une mauvaise correspondance entraîne des doublons ou des mises à jour incorrectes.

Les schémas de données doivent être maîtrisés. Toute modification non anticipée peut interrompre la synchronisation si le mapping n’est pas ajusté.

Le monitoring des flux est indispensable pour détecter les échecs de synchronisation ou les anomalies de volume.

La gestion de la latence doit être adaptée aux usages. Certains cas nécessitent une actualisation quasi immédiate, tandis que d’autres peuvent fonctionner avec une synchronisation quotidienne.

Gouvernance des données et conformité RGPD : un cadre indispensable

Activer les données élargit leur périmètre d’utilisation. La gouvernance des données devient donc stratégique.

Le principe de minimisation prévu par le RGPD impose de ne synchroniser que les champs strictement nécessaires à l’usage métier. Transmettre l’ensemble d’une fiche client vers un outil qui n’exploite que quelques attributs augmente inutilement les risques.

En 2024, 5 629 notifications de violations de données personnelles ont été enregistrées en France selon la CNIL, soit une hausse de 20 % par rapport à l’année précédente. Cette progression souligne la nécessité de documenter chaque flux, de tracer les accès et de contrôler régulièrement les droits.

Un projet Reverse ETL doit intégrer des responsabilités clairement définies, des tests systématiques avant mise en production et une traçabilité complète des opérations.

Comment mesurer la performance d’une stratégie Reverse ETL

La mise en œuvre technique ne suffit pas. La valeur d’une stratégie d’activation des données doit être mesurée.

Parmi les indicateurs pertinents figurent le taux d’erreur de synchronisation, la fraîcheur des données dans les outils métier, le taux d’adoption par les équipes et l’impact sur le cycle de vente ou la rétention client.

Le Reverse ETL permet d’exploiter pleinement les données du data warehouse dans les applications opérationnelles. Lorsqu’il est correctement structuré et gouverné, il améliore la cohérence des informations et renforce l’efficacité des équipes.